Die Qualität moderner Software entscheidet zunehmend über den Erfolg technischer Produkte. Gleichzeitig steigt die Komplexität – insbesondere bei Embedded-Systemen, die in sicherheitskritischen Bereichen wie der Elektromobilität, Industrieautomation oder Medizintechnik eingesetzt werden. Klassische Testverfahren geraten dabei immer häufiger an ihre Grenzen. Genau an diesem Punkt gewinnt ein neuer Ansatz an Bedeutung: KI-gestützte Testfallgenerierung.

Statt Testfälle ausschließlich manuell zu definieren, nutzt dieser Ansatz vorhandene Testdaten und erweitert sie mithilfe von Machine Learning. Das Ziel ist nicht nur Effizienz, sondern vor allem eine bessere Abdeckung komplexer Systemzustände – also genau der Situationen, in denen Fehler besonders schwer zu erkennen sind.

In Entwicklungsprozessen entstehen bereits heute große Mengen an Testdaten. Sie stammen aus verschiedenen Quellen: von automatisierten Tests, von Integrationstests oder auch aus realen Feldversuchen. Diese Daten enthalten wertvolle Informationen über das Verhalten eines Systems – werden aber oft nur zur unmittelbaren Auswertung genutzt.

Das Forschungsprojekt DeepTest von ITPower Solutions verfolgt einen anderen Ansatz: Es nutzt diese Daten als Grundlage für ein lernendes System, das neue Testfälle generieren kann. Die zentrale Frage dabei lautet, ob sich aus bestehenden Testverläufen neue und realitätsnahe Tests ableiten lassen.

Um dies zu ermöglichen, werden Testdaten nicht nur als einfache Messwerte betrachtet. Stattdessen interpretiert die KI sie als zeitliche Signalverläufe – also als Muster, die sich über die Zeit entwickeln. Alternativ können diese Verläufe auch als visuelle Darstellungen betrachtet werden, ähnlich den Kurvenbildern eines Oszilloskops. Beide Sichtweisen ergänzen sich und ermöglichen es, komplexe Zusammenhänge zu erkennen, die bei isolierter Betrachtung einzelner Werte verborgen bleiben.

Ein zentraler Aspekt der KI-gestützten Testfallgenerierung ist das Erkennen von Mustern. In technischen Systemen existieren zahlreiche implizite Regeln, die das Verhalten bestimmen. Wird beispielsweise ein Signal ausgelöst, muss ein anderes Signal mit einer bestimmten Verzögerung folgen. In vielen Fällen müssen mehrere Signale synchron verlaufen oder sich gegenseitig beeinflussen.

Solche Abhängigkeiten sind in klassischen Tests oft nur unvollständig beschrieben. Sie entstehen vielmehr implizit im System und spiegeln sich in vorhandenen Testdaten wider. Genau hier setzt Machine Learning an: Die Modelle lernen diese Zusammenhänge aus den Daten selbst – ohne dass sie explizit vorgegeben werden müssen.

Das bedeutet auch, dass sich Testfälle nicht mehr ausschließlich aus Spezifikationen ableiten, sondern aus realem Systemverhalten. Damit verschiebt sich der Fokus vom manuellen Entwurf hin zur datengetriebenen Testfall-Generierung.

Um diese Muster zu erkennen und neue Testdaten zu erzeugen, kommen verschiedene Verfahren aus dem Bereich Machine Learning zum Einsatz. Besonders relevant sind generative Modelle, die neue Daten erzeugen können, anstatt nur bestehende zu analysieren.

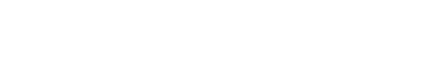

Eine zentrale Rolle spielen sogenannte Generative Adversarial Networks (GANs). Diese bestehen aus zwei miteinander konkurrierenden neuronalen Netzen: Während ein Netz neue Daten generiert, bewertet ein anderes deren Qualität. Dieser Wettbewerb führt dazu, dass die generierten Daten mit der Zeit immer realistischer werden. In der Praxis haben sich insbesondere Wasserstein GANs als stabil und leistungsfähig erwiesen, da sie Unterschiede zwischen echten und generierten Daten präziser erfassen (Abbildung 1).

Daneben kommen auch Variational Autoencoder VAE zum Einsatz, die Daten komprimieren und anschließend rekonstruieren. Sie lernen dabei die wesentlichen Strukturen der Daten und können daraus neue Varianten erzeugen. Ein dritter Ansatz sind sogenannte Wavenets, die speziell für Zeitreihen entwickelt wurden und Signalverläufe auf Basis vergangener Werte fortschreiben.

Interessant ist dabei, dass die Modelle zunächst keine klassische Trennung zwischen Eingaben und Ausgaben eines Systems kennen. Sie betrachten lediglich Signalverläufe. Erst im Anschluss werden die generierten Daten wieder in Eingaben und erwartete Reaktionen aufgeteilt – wodurch vollständige Testfälle entstehen.

Ein entscheidender Fortschritt dieses Ansatzes liegt in der Bewertung der generierten Testdaten. Während viele KI-Anwendungen auf subjektive oder visuelle Beurteilungen angewiesen sind, wurde im Projekt ein quantitativer Bewertungsansatz entwickelt.

Dabei werden bekannte Signalregeln formal beschrieben und anschließend überprüft, ob die generierten Daten diese Regeln einhalten. Die Qualität eines generierten Testdatensatzes lässt sich somit anhand messbarer Kriterien bestimmen, etwa durch den Anteil korrekt reproduzierter Muster.

Diese objektive Bewertung ist besonders wichtig, da sie den Einsatz von KI im Testprozess erst wirklich belastbar macht. Ohne nachvollziehbare Metriken wäre der praktische Einsatz solcher Verfahren nur schwer zu rechtfertigen.

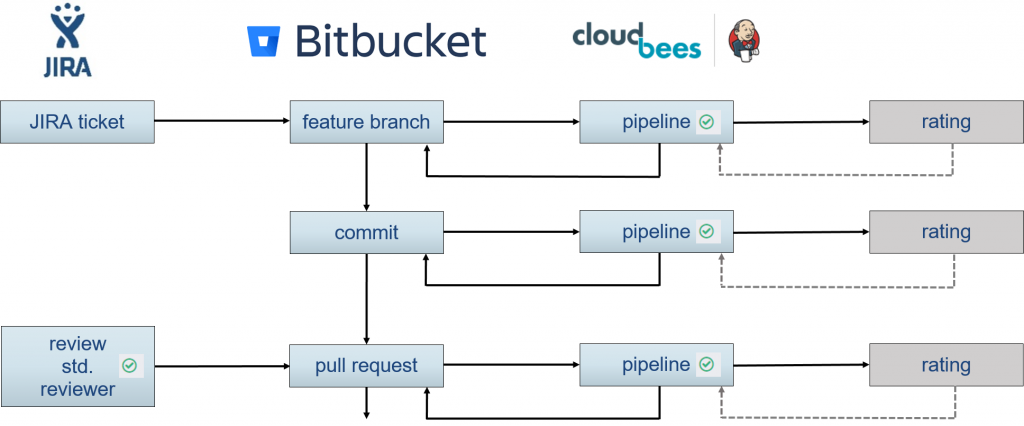

Ein großer Vorteil der KI-gestützten Testgenerierung liegt in ihrer Integration in bestehende Continuous-Integration-Prozesse. Testdaten, die ohnehin im Entwicklungsprozess entstehen, können direkt zur Verbesserung der Modelle genutzt werden.

So entsteht langfristig ein selbstlernendes System, das mit jeder Iteration besser wird. Neue Codeänderungen führen nicht nur zu neuen Tests, sondern gleichzeitig zu einer Erweiterung der Wissensbasis der KI. Die Testgenerierung wird damit zu einem kontinuierlichen Prozess, der sich dynamisch an das System anpasst (Abbildung 2).

Die bisherigen Ergebnisse zeigen, dass KI-gestützte Testgenerierung grundsätzlich funktioniert und einen echten Mehrwert bietet. Besonders Wasserstein GANs liefern überzeugende Resultate und erreichen eine hohe Übereinstimmung mit definierten Signalregeln. Auch Wavenets zeigen vielversprechende Ansätze, insbesondere bei der Modellierung zeitlicher Abhängigkeiten.

Ein bemerkenswerter Aspekt ist, dass sich die generierten Daten visuell kaum von echten Testdaten unterscheiden. Unterschiede werden erst durch die quantitative Analyse sichtbar – was die Bedeutung objektiver Bewertungsmethoden unterstreicht.

Trotz der vielversprechenden Ergebnisse ist die KI-gestützte Testgenerierung kein Allheilmittel. Ein zentraler Punkt ist die Abhängigkeit von vorhandenen Daten. Die Qualität der generierten Tests hängt unmittelbar von der Qualität und Vielfalt der Trainingsdaten ab. Sind bestimmte Szenarien in den Daten nicht enthalten, können sie auch von der KI nicht zuverlässig erzeugt werden.

Ein weiteres Problem besteht darin, dass nicht alle relevanten Muster im System bekannt oder eindeutig definierbar sind. Die KI kann zwar implizite Zusammenhänge lernen, doch deren Interpretation bleibt teilweise intransparent. Dies erschwert insbesondere in sicherheitskritischen Bereichen die Nachvollziehbarkeit der Ergebnisse.

Auch die Bewertung der generierten Daten ist trotz quantitativer Ansätze nicht trivial. Die definierten Metriken decken nur einen Teil möglicher Qualitätsaspekte ab. Es besteht weiterhin die Gefahr, dass generierte Tests formal korrekt sind, aber dennoch keine relevanten neuen Erkenntnisse liefern.

Hinzu kommt der technische Aufwand. Die Entwicklung, das Training und die Integration solcher Modelle erfordern spezialisiertes Know-how sowie entsprechende Infrastruktur. Für viele Unternehmen stellt dies zunächst eine Einstiegshürde dar.

Die KI-gestützte Testgenerierung eröffnet neue Möglichkeiten für das Testen komplexer Systeme. Sie ermöglicht es, vorhandene Testdaten effizient zu nutzen und daraus neue, realistische Testfälle abzuleiten. Insbesondere in Bereichen mit hoher Systemkomplexität kann dies zu einer deutlichen Verbesserung der Testabdeckung führen.

Gleichzeitig zeigt sich, dass der Ansatz sorgfältig eingesetzt werden muss. Die Qualität der Ergebnisse hängt stark von den zugrunde liegenden Daten, den verwendeten Modellen und den Bewertungsmethoden ab. KI ersetzt nicht das klassische Testen, sondern ergänzt es sinnvoll.

Für Unternehmen, die sich frühzeitig mit diesem Ansatz beschäftigen, bietet sich jedoch ein klarer Wettbewerbsvorteil. Denn die Fähigkeit, Testprozesse intelligent zu automatisieren und kontinuierlich zu verbessern, wird zunehmend zu einem entscheidenden Faktor in der Softwareentwicklung.

Ich bin Ihr vertrieblicher Ansprechpartner und berate Sie gerne zu allen Fragen rund um unsere Dienstleistungen und Produkte! Melden Sie sich oder vereinbaren Sie einfach einen Termin für ein kostenloses Beratungsgespräch.

Sebastian Stritz

E-Mail: sebastian.stritz@itpower.de

Telefon: +49 (0)30 6098501-17